ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」をあなたに。

ロジです。

この記事は、次のような方へ向けて書きました。

- 機密データを守りたいプロフェッショナル:Googleに未発表データを渡すことに躊躇する研究者や実務家。

- 自律したいエンジニア:クラウドの「利用規約」ではなく、自分の「技術」で環境を管理したい方。

- 最適解を探す探求者:Geminiだけでなく、LlamaやClaudeを適材適所で使い分けたい方。

Googleの「NotebookLM」は、情報処理における強力なツールです。

PDFを読み込ませる。要約させる。対話する。

その体験は鮮烈でした。

しかし、サービスの制御権はGoogleにあります。

「データは学習に使わない」という規約を信じるか。

それとも、万が一の流出リスクを恐れて、重要なデータをアップロードする手を止めるか。

多くの専門家が、このジレンマに直面しています。

そこで、「Open Notebook」です。

これは、あなたのPCの中にだけ存在する、あなただけの研究所。

今回は、このツールがなぜNotebookLMの代替を超え、AI活用の「最適解」になり得るのか。

導入の壁となるDockerを含め、ロジカルに解説します。

クラウドからの「脱出」が必要な理由

AIの進化は、クラウドへの依存とセットでした。

しかし、潮目は変わりました。

1. データの「主権」を取り戻す

NotebookLMを使う以上、データはGoogleのサーバーに送信されます。

企業秘密。個人情報。未発表の論文。

これらを外部サーバーに保存するリスクと心理的コストは無視できません。

Open Notebookは違います。

オープンソースであり、ローカル環境で完結する。

LANケーブルを抜いても動く。

この物理的な遮断こそ、確実なセキュリティです。

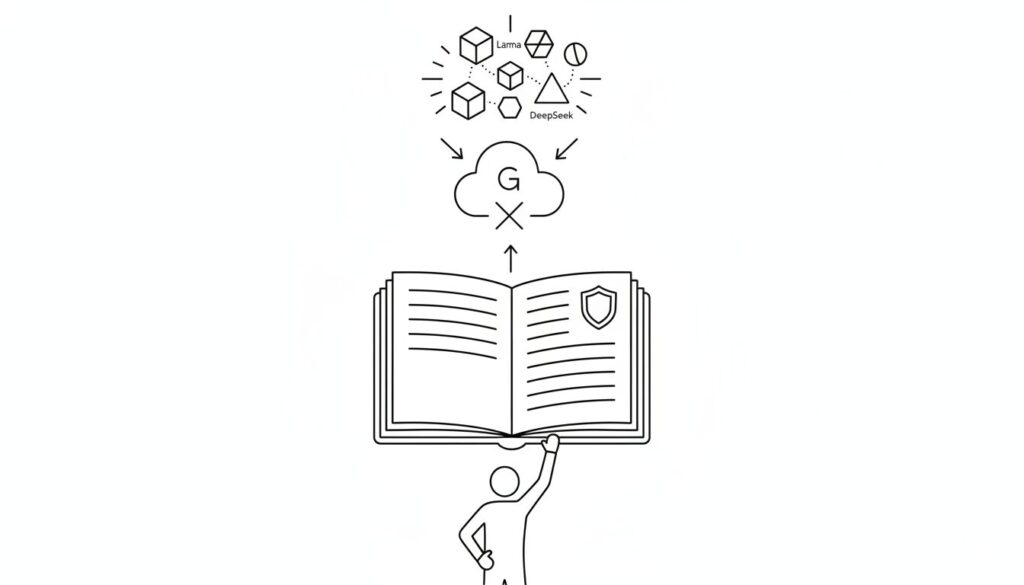

2. 「モデル」を選べる自由

NotebookLMのモデルはGemini 1.5 Pro固定です。

優秀ですが、選択権はありません。

Open Notebookなら、バックエンドのAIを自由に選べます。

- 論理構成ならClaude 3.5 Sonnet。

- オフラインかつ高速処理ならLlama 3。

- コーディング特化ならDeepSeek。

タスクに応じてAIを切り替える。

この柔軟性は、クラウドサービスでは得られない特権です。

Open Notebookの正体

GitHubで開発が進む「Open Notebook(lfnovo版など)」。

NotebookLMのコア機能を再現しつつ、拡張性は別次元です。

機能の解剖

ブラウザを開き、ポート「8502」にアクセスする。

そこに現れるUIは、洗練されています。

- ソース管理: PDF、URL、テキスト。あらゆる情報をプロジェクト単位で管理。

- RAG(検索拡張生成): 資料に基づいた正確な回答。根拠の提示。

- メモと整理: 思考の断片を記録する。

特筆すべきは「AIポッドキャスト」機能の実装も進んでいる点。

ローカルLLMと音声合成技術が連携し、手元の資料についてAI同士が議論を始める。

これを自宅のPCで実行できるのです。

【ロジの視点】

研究者の性(さが)でしょうか。私は「与えられた環境」に満足できません。NotebookLMは完成された「製品」ですが、Open Notebookは「実験場」です。「この論文、Llama 3ならどう解釈する?」とモデルを切り替えて試す。結果がガラリと変わる瞬間、AIの処理プロセスが少しだけ透けて見える。この知的興奮は、病みつきになります。

「Docker」の壁を突破する

導入には「Docker」が必要です。

ここで脱落する人が多い。

非常にもったいない。

コンテナ技術による環境構築の効率化

環境構築は、本来複雑な作業です。

依存関係のエラー。バージョンの不整合。

Dockerはこれを解決しました。

必要なプログラム一式を「コンテナ」としてパッケージ化して配布するからです。

手順はシンプルです。

- Docker Desktopをインストールする。

- Open Notebookのコード(リポジトリ)を取得する。

- コマンド(

docker compose up)を実行する。

これだけ。

あなたのPC内に、サーバー環境が再現されます。

ちなみに、余談ですが…

私も最初はDockerの「ポートフォワーディング(8502:8502)」という概念で躓きました。「入り口と出口をつなぐ」だけの話なのですが、理解するのに一晩かかりました(笑)。でも、一度覚えると世界が変わります。あらゆる最新技術が、コマンド一つで手元に呼び出せるようになるのですから。

知能を統合する:Ollamaとの連携

Open Notebookはプラットフォームです。

AIモデルを動作させるには、「Ollama」を使います。

- Ollamaを起動: 公式サイトからインストール。ターミナルでモデルをダウンロード(例:

ollama pull llama3)。 - 接続: Dockerコンテナからホスト側のOllamaを見る設定をする(

host.docker.internalなど)。

これで接続完了。

インターネットがなくても、数千ページの文献をAIが分析します。

高度なAI処理がローカル環境で実行される。

この感覚は、クラウドでは味わえません。

KEY SIGNAL:

真の贅沢。それは最新モデルを使うことではありません。「どのモデルを」「どのデータに」適用するか。その全ての決定権を、あなた自身が握っている状態を指します。

まとめ:主権のある知的生産へ

ポイントを整理します。

- 絶対的なプライバシー:データはPCから出ない。

- 選択の自由:Geminiに縛られない。Ollamaでモデルを自在に設定する。

- スキルの獲得:Dockerという現代エンジニアの必須教養が身につく。

- コスト:基本無料。APIを使う場合のみ従量課金。

導入のハードルは、確かにあります。

しかし、それを越えた先には「自由」があります。

誰にも検閲されず、誰にもデータを渡さない。

あなたとAIだけの、静謐な対話空間。

週末、少し時間をとって環境を作ってみてください。

エラーが出たら、それもまた一興。

解決した時、あなたはAIの「利用者」から「管理者」へと進化しています。

以上、最後まで読んでいただきありがとうございました。

当メディア「AI Signal Japan」では、

ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」だけを抽出し、分かりやすくお届けしています!

運営者は、ロジ。博士号(Ph.D.)を取得後も、知的好奇心からデータ分析や統計の世界を探求しています。

アカデミックな視点から、表面的なニュースだけでは分からないAIの「本質」を、ロジカルに紐解いていきます。