「AIのニュース、単語がむずかしくて置いていかれる…」って、ありますよね。

今日は“用語を覚える”より先に、仕事や日常でAIを安全に使うための「言い換え」と「確認の型」をまとめます。ChatGPTやClaudeにそのままコピペできるプロンプトも付けました。

目次

まず結論:用語は「3つだけ」押さえると回り始める

TechCrunchのAI用語ガイド(用語集)を見ていて思ったのは、全部を暗記する必要はないってことです。これから使い始める人がまず困るのは、だいたい次の3つです。

- LLM(大規模言語モデル):文章をそれっぽく作るのが得意な“文章エンジン”。正しさは別途チェックが必要。

- ハルシネーション(幻覚):AIが自信満々に間違いを混ぜる現象。バグというより「仕様」寄り。

- エージェント(AIが手順を進める仕組み):調べるだけじゃなく、クリックやファイル操作など“作業”までやろうとするタイプ。

この3つが分かると、ニュースもツール選びも、急に読みやすくなります。

こんな人におすすめ

- ChatGPTやClaudeを使っているけど、用語が壁になって手が止まる人

- AIの回答が合ってるか不安で、結局コピペできない人

- 社内やチームで「AIの出力をどう扱うか」を軽くルール化したい人

用語を「使う側の言葉」に翻訳するミニ辞書

LLM(大規模言語モデル)

ざっくり言うと、文章の続きを当てるのが上手いAIです。知識もそれっぽく語れますが、「最新情報」「社内事情」「数字の正確さ」は別問題。なので運用としては下書き担当に置くのがちょうどいいです。

ハルシネーション(幻覚)

「そんな法律はない」「存在しない機能をあると言う」「引用元をそれっぽく捏造する」みたいなやつです。ポイントは、丁寧な文章ほど信じたくなること。自分の脳が騙される前提で、確認の手順を決めるのが勝ちです。

コンテキスト(文脈)

AIが会話の流れや、貼った資料を覚えている“範囲”です。長い相談をするほど効いてきます。逆に、前提を出し惜しみすると、出力のブレが増えます。

プロンプト(指示文)

魔法の呪文というより、依頼書です。「目的」「材料」「制約」「出力形式」を渡すと、ミスが減ります。

エージェント(AIが手順を進める仕組み)

ニュースでも「デスクトップAIエージェント」が増えていて、便利な一方で、深い権限(アプリ操作やログイン)を渡すほど事故が起きやすいです。まずは“提案だけ”をさせる運用から始めるのがおすすめ。

今日からできる:ChatGPT/Claudeの「回答チェック」4ステップ

ここが本題です。用語を覚えても、使い方が変わらないと不安は消えません。僕は次の流れで、AIの出力を“そのまま使える形”に寄せています。

手順1:最初に「役割」を固定する

いきなり質問すると、AIが「友だち口調の雑談」になったり「専門家口調で断言」になったりします。最初に役割を置くと、ブレが減ります。

あなたは私の業務アシスタントです。

目的は「私が最終判断するための材料を整えること」。

不確かな点は断言せず、確認手順と代替案を出してください。手順2:「根拠の形」を指定する(ここ超大事)

ハルシネーション対策は、根性ではなく型です。おすすめは「仮説」と「要確認」を分けさせること。

次の回答を作るとき、必ずこの形式で出してください。

1) 結論(短く)

2) 前提(私が追加で確認すべきこと)

3) 根拠(一般知識ベースならそう明記)

4) 不確実な点(要確認リスト)

5) 私が次にやるべき確認手順(3つ)手順3:「反証(つっこみ役)」をやらせる

AIは基本、依頼に協力的です。だから一回“ツッコミ役”に切り替えると精度が上がります。

今の回答に対して、厳しめのレビュー担当として動いてください。

間違いの可能性、誤解されそうな表現、数字や固有名詞の怪しい点を指摘し、修正版を出してください。手順4:最後に「使う形」へ整形する

ここまでやっても、文章が長かったり、社内共有しづらかったりします。最後に納品形式へ。

上の内容を、Slackに貼れる長さに要約してください。

・200〜300文字

・箇条書き中心

・「要確認」だけは必ず残す深刻な“だまされ方”を避ける:深偽情報(ディープフェイク)時代のミニ習慣

ManusのAIエージェントがきっかけで、ディープフェイク(AIで作った偽の画像・音声・動画)への不安が話題になっています。これ、専門家じゃなくても巻き込まれるんですよね。例えば「偽の音声で指示が来た」「それっぽいスクショが回ってきた」みたいな。

僕が個人的に効くと思ってるミニ習慣はこの2つです。

- “出どころ”を先に聞く:内容の真偽より前に「それ、どこで見た?」を徹底する

- 即レスしない:焦る連絡ほど危ないので、5分置いて確認ルートに乗せる

そしてAIにも、検証の段取りを作らせるとラクです。

次の情報が本当か不安です。私は今すぐ検索に飛ばずに、確認の順番だけ決めたいです。

・まず確認すべきポイント(3つ)

・怪しいと判断するサイン(5つ)

・私が取るべき安全な次アクション(3つ)

情報:

(ここに文章やスクショの内容を貼る)無料で使える?料金は?(2026年4月時点の考え方)

料金は地域やプラン改定で変わりやすいので、ここでは“判断の軸”だけ置きます。

- ChatGPT:無料枠でも試せます。日常用途は無料で十分なことが多いですが、混雑時の制限やモデル(頭の良さ)の選択肢がプランで変わります。

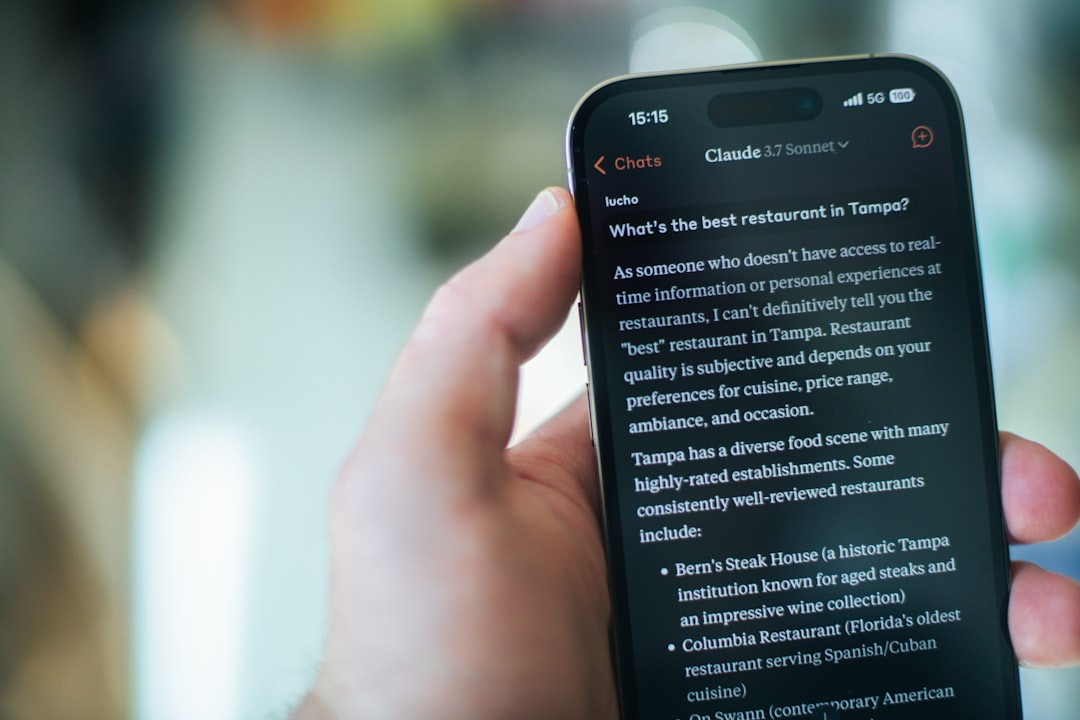

- Claude:無料枠あり。文章の読み書きや長文の扱いが得意で、仕事の下書きにハマる人が多い印象。こちらも上位プランで上限が緩くなります。

- Gemini:Google系の連携が強み。無料枠から触れますが、機能はプランや提供地域で差が出ます。

迷ったら、まず無料で「チェック用プロンプト(このページの4ステップ)」だけ回してみるのがおすすめです。課金は、その後に“回数制限で詰まったら”でOKです。

まとめ:まずは「用語」より「確認プロンプト」をコピペしよう

AI用語って、分かった瞬間は気持ちいいんですが、実際に楽になるのは運用の型を持ったときです。

- LLMは下書き担当。正しさは別途チェックする

- ハルシネーションは起きる前提で、根拠の出し方を指定する

- 反証(つっこみ役)を挟むと、実務に耐える確度になる

今日やるなら、まずはこの記事の「手順2(根拠の形を指定)」だけでもコピペして試してみてください。体感でミスが減って、AIへの不安が一段落ちます。

参考リンク

- From LLMs to hallucinations, here’s a simple guide to common AI terms(TechCrunch AI)

- Manus AI agent ignites fear of a ‘deepfake’ explosion online: What users need to know(The News International)

- At the HumanX conference, everyone was talking about Claude(TechCrunch AI)