ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」をあなたに。

ロジです。

セキュリティ業界を席巻する「AIによる自動化」の波。しかし、実務の最前線から聞こえてくるのは、称賛の声だけではありません。

英国のセキュリティ企業Intruderが公開した最新の研究データは、大規模言語モデル(LLM)を脆弱性検知に適用した際の「失敗」と、そこから導き出された「現実解」を赤裸々に報告しています。

なぜ、高機能なはずのLLMが単純な構文エラーを繰り返したのか。そして、エンジニアたちはどうやってその壁を突破したのか。

今日は、バズワードとしてのAIではなく、実用的なエンジニアリングの観点から、脆弱性検知におけるAI活用の現在地を解析します。

この記事は、次のような方へ向けて書きました。

- AIによるセキュリティ運用の自動化を検討中のCISOや技術責任者

- LLMのハルシネーションや実装精度に課題を感じているエンジニア

- 「Nuclei」などのスキャナー活用とAIの連携に興味があるセキュリティリサーチャー

セキュリティにおけるAI導入は、魔法のような解決策をもたらすわけではありません。それは、泥臭い試行錯誤の上に成り立つ、高度なエンジニアリングの集積です。

目次

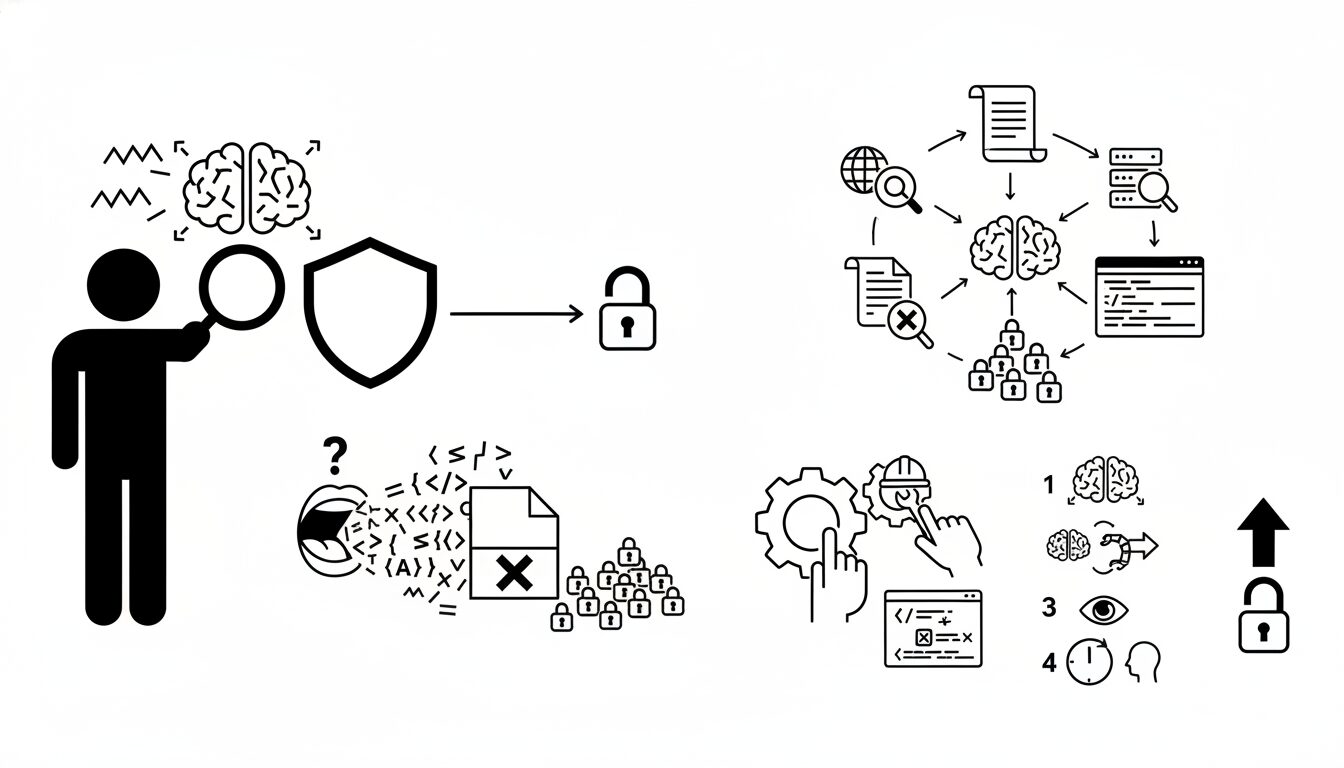

LLMの「知ったかぶり」が招くリスク:Nucleiテンプレート生成の失敗事例

脆弱性管理の要諦は、攻撃者が悪用する前にセキュリティホールを塞ぐスピードにあります。Intruder社はこのプロセスを加速させるため、オープンソースのスキャナー「Nuclei」の検知テンプレート作成をAIに委ねようと試みました。

しかし、初期のアプローチは芳しくない結果に終わります。

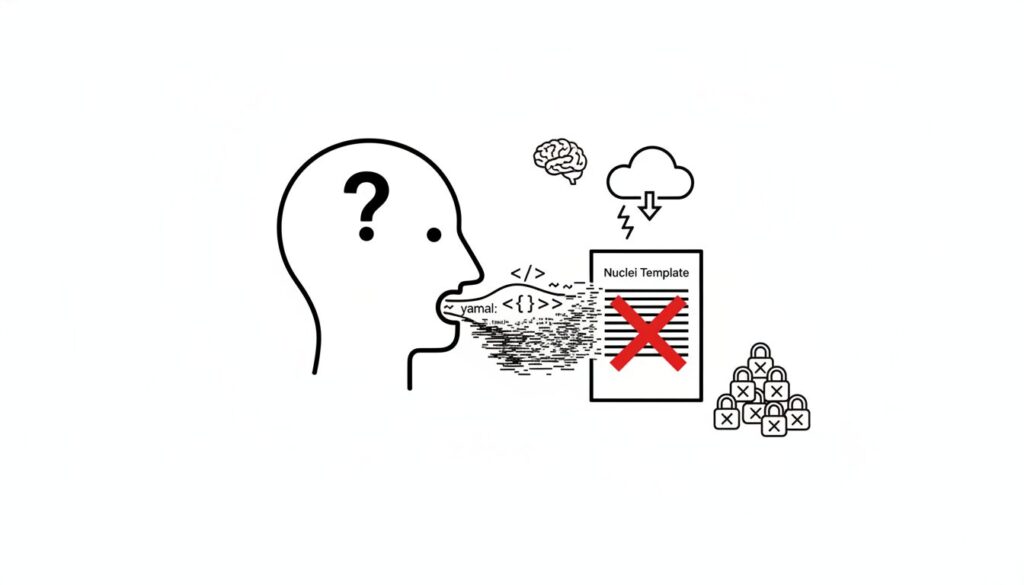

存在しない機能を捏造するAI

彼らが直面したのは、LLMがもっともらしく嘘をつく「ハルシネーション(幻覚)」の問題でした。

LLMに直接テンプレート(YAML形式)の生成を指示したところ、実際には存在しないNucleiの機能を呼び出そうとするコードや、構文的に破綻した形式が出力されました。さらに、生成されたマッチャー(照合ルール)の精度は低く、誤検知の山を築くだけでした。

確率論的に「次に来る単語」を予測するだけのモデルでは、厳密な論理整合性が求められるセキュリティツールの仕様を遵守できません。文脈を持たないAIに専門的なタスクを丸投げすることは、砂上の楼閣を築く行為に等しいのです。

この行き詰まりが、Intruder社のエンジニアたちを、より洗練されたアプローチへと導くことになります。

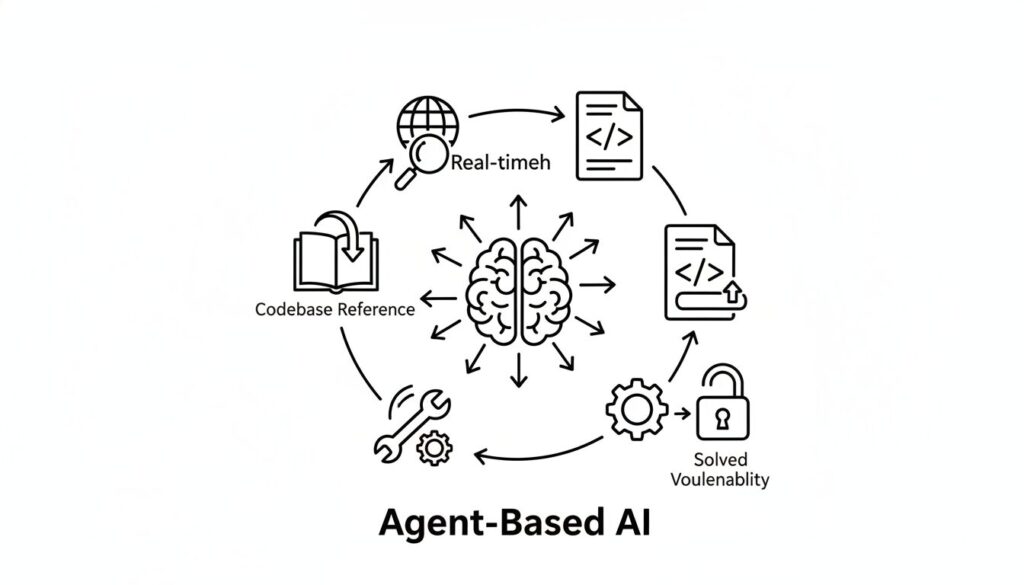

「単独」から「協調」へ:エージェント型AIが突破口となる理由

単体のLLMが抱える限界を克服するために採用されたのが、「エージェント型」のアプローチです。

Intruder社は、コード生成エディタ「Cursor」などを活用し、AIに自律的な調査能力を付与しました。AIを孤独な作業者から、道具を使えるリサーチャーへと進化させたのです。

外部リソースへのアクセス権限

この転換における決定的な差分は、AIが以下の外部情報へアクセスできるようになった点にあります。

- リアルタイム検索: 最新の脆弱性情報や公式ドキュメントを自ら検索し、知識を補完する。

- コードベースの参照: 既存の正常に動作するテンプレートやルールセットをインデックスとして読み込み、模倣する。

結果は劇的でした。

AIは、過去の成功パターンと最新のドキュメントを参照することで、一貫性のある高品質なテンプレートを出力し始めました。

具体的には、インターネット上に公開されている管理パネルや、設定不備のある「Elasticsearch」インスタンスを検知するための、複数のリクエストを組み合わせた複雑なシナリオさえも、正確に記述できるようになったのです。

【ロジの視点】

この事例が示唆するのは、AIの性能は「モデルのパラメータ数」だけでなく「与えられたコンテキストの質」に依存するという事実です。セキュリティエンジニアの役割は、コードを書くことから、AIに対して正確な「地図(ドキュメント)」と「辞書(既存コード)」を与え、正しい方向へナビゲートすることへとシフトしています。

完全自動化の幻想を捨て、人間の役割を再定義する

エージェント型アプローチは成果を上げましたが、Intruder社の結論は冷静です。彼らはAIによる「完全自動化」を目指すのではなく、人間とAIの協働体制を構築する道を選びました。

依然として残る「見落とし」と「暴走」

研究の中では、AIエージェント特有の新たな課題も報告されています。

- 効率化による情報の切り捨て: AIが処理効率を優先し、人間ならば気づく重要な識別情報を勝手に省略してしまう。

- 仕様の忘却と退化: 既存のNuclei機能を忘れ、非効率で冗長なシェルスクリプトを生成しようとする。

- 誤検知の発生: 生成されたルールの条件が甘く、無害な通信を脅威として報告してしまう。

これらのエラーを修正し、最終的な品質を担保するのは、依然として熟練したエンジニアの仕事です。

AIは定型的なコーディングや初期ドラフトの作成時間を大幅に短縮しますが、最終的な判断権限を委譲できるレベルには達していません。

Intruder社は、AIを「エンジニアを代替するもの(Replacement)」ではなく、「時間を創出し、より高度な分析に集中させるための拡張機能(Augmentation)」として定義づけました。

KEY SIGNAL:

脆弱性検知におけるAIの真価は、人間の作業をゼロにすることではなく、エンジニアが「人間にしかできない高度な判断」にリソースを集中できるよう、認知負荷を下げる点にある。

まとめ:AIを飼いならすための現実的なステップ

Intruder社の研究は、セキュリティ運用におけるAI活用の解像度を一段階引き上げました。

この記事のポイントをおさらいしましょう。

- LLMへの直接指示は非効率: 厳密な仕様が求められるタスクでは、ハルシネーションや構文エラーが障壁となる。

- コンテキストの重要性: 検索機能やリポジトリ参照権限を持つ「エージェント型」の運用が、実用的なコード生成の必須条件である。

- 人間による監督の不可欠性: AIは効率化のために必要な情報を捨てる傾向があるため、専門家によるレビュー体制が欠かせない。

- 目的の再設定: 完全自動化を目指すのではなく、エンジニアの知的生産性を最大化するためのツールとしてAIを位置づける。

テクノロジーは、それを扱う人間の理解度を超えては機能しません。

AIの得意なことと苦手なことを冷徹に見極め、適切なガードレールを設けて運用すること。それこそが、次世代のセキュリティエンジニアに求められる最も重要なスキルセットなのです。

以上、最後まで記事を読んでいただきありがとうございました。

当メディア「AI Signal Japan」では、

ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」だけを抽出し、分かりやすくお届けしています!

運営者は、ロジ。博士号(Ph.D.)を取得後も、知的好奇心からデータ分析や統計の世界を探求しています。

アカデミックな視点から、表面的なニュースだけでは分からないAIの「本質」を、ロジカルに紐解いていきます。