ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」をあなたに。

ロジです。

2025年11月5日から6日にかけて発表された、GoogleマップとGeminiの統合。これは単なる機能アップデートではありません。製品のアイデンティティにおける根本的なパラダイムシフトです。

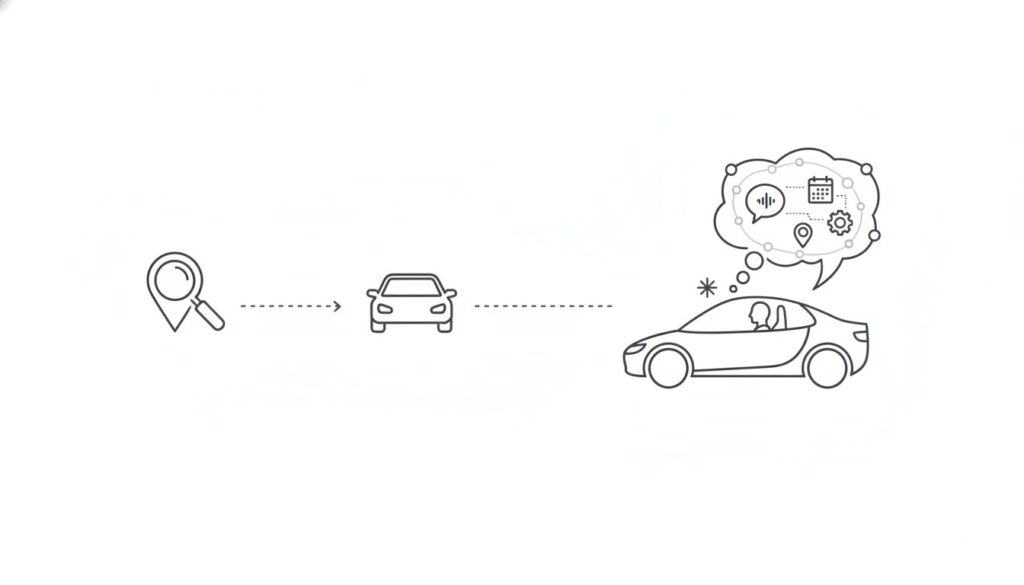

Googleマップは、過去20年近く「場所を検索し、そこへ到達する」ための最高クラスの道具(ユーティリティ)として機能してきました。今回の統合により、Googleマップは「あなたの旅全体を文脈的に理解し、積極的に支援する」ためのエージェント(主体)、すなわち「インテリジェントな旅行コンパニオン」へと進化します。

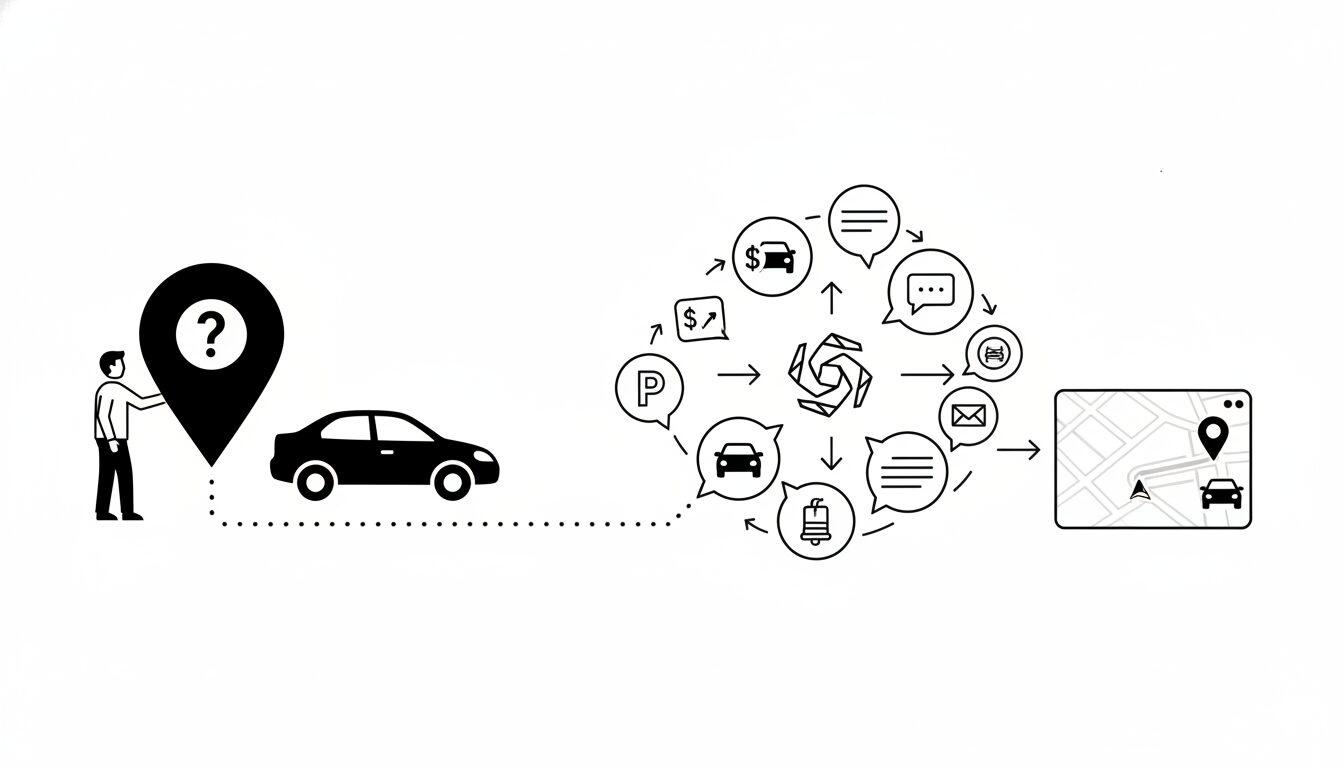

この戦略の核心は、ユーザーの操作方法を「タップと検索」から「会話と文脈理解」へと根本的に移行させることにあります。これは、従来のGoogleアシスタントが達成できなかった、より複雑で多段階の対話処理を実現する試みです。

Googleマップは、AIを「追加」するのではありません。Googleマップ自体が、GeminiというOSレベルのインテリジェンス・レイヤーの「目(世界の認識)」であり「実行アーム(物理的な案内)」として再定義されるのです。

この記事は、次のような方へ向けて書きました。

- 最新のAIナビゲーション技術の「本質」を知りたい方

- GeminiがGoogleマップをどう具体的に変えるのか、その全体像を理解したい方

- AIの利便性と、その裏にある安全性やプライバシーのリスクを冷静に評価したい方

この歴史的なアップデートの核心を、冷静に解体していきましょう。

目次

2025年11月アップデートの解体:変革の4つの柱

今回のアップデートで発表された4つの主要な新機能は、個別に機能するのではなく、連携して「インテリジェントな旅行コンパニオン」というビジョンを形成します。

柱1:会話型ナビゲーション (Gemini in Navigation)

今回のアップデートの核となる機能です。これは従来のGoogleアシスタントを置き換えるもの。最大の違いは、単一のコマンドを超えて、複数の制約を持つ複雑なリクエストを理解し、文脈を維持したまま対話を継続できる点にあります。

例えば、以下のような、従来の音声アシスタントでは処理が困難だった多段階のクエリが可能になります。

「ルート沿線で、4マイル以内にある、安価で、菜食主義者向けのオプションがあり、駐車場があるレストランを探して」

Geminiが候補を提示した後、ドライバーは「そこの駐車場の状況は?」あるいは「人気の料理は?」といったフォローアップの質問を続けることができ、AIは文脈を記憶したまま応答します。

さらに、この機能はマップアプリ内で完結しません。ナビゲーション画面を離れることなく、「この会議のために、明日の午後5時にカレンダーイベントを追加して」といった、他のGoogleツールとのシームレスな連携(アプリ間連携)も実現します。

また、従来は画面タップが必要だった交通状況の報告も、「事故が見える」「道路が冠水しているようだ」と自然に話すだけで、リアルタイムのアラートとして共有されます。

柱2:ランドマーク(目印)ベースのナビゲーション

AIが生成する、より視覚的で直感的な運転案内への移行です。

従来の「500フィート(約150m)先を右折」といった抽象的な距離ベースの指示から、「Thai Siam Restaurant(タイ・サイアム・レストラン)を過ぎたら右折」といった、ルート上にある目立つランドマーク(目印)を基準にした案内に変わります。

これは単にデータベースの名前を読み上げているのではありません。GeminiがGoogleマップの膨大な2億5000万件の場所情報を分析し、それをストリートビューの画像と相互参照することで、「通りから最もよく見える、有用な目印」をAIが厳選しています。

これにより、ドライバーの認知負荷(抽象的な距離の推定)を軽減し、よりストレスの少ないナビゲーション体験を目指します。

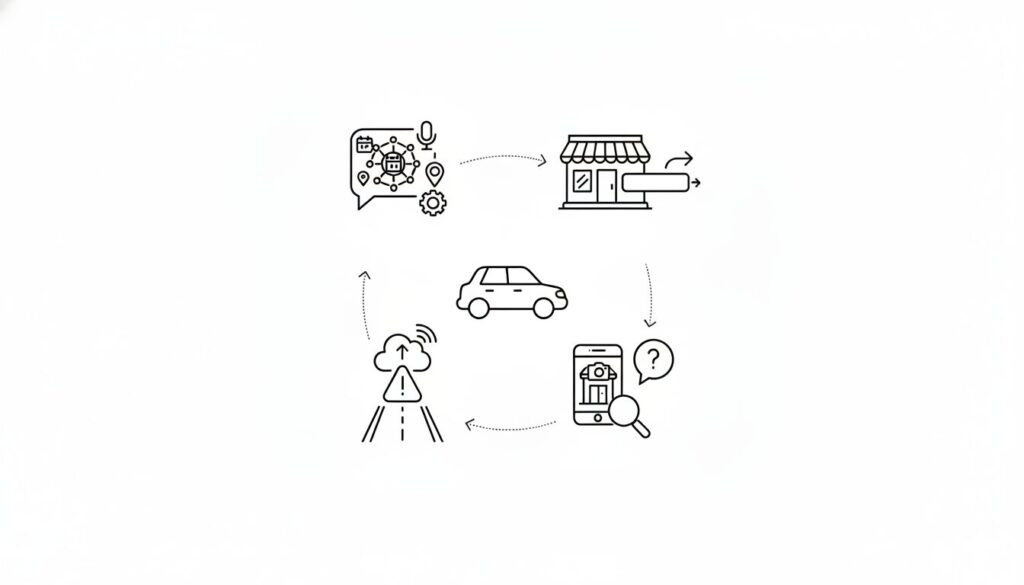

柱3:積極的な(プロアクティブな)交通アラート

この機能は、ユーザーがナビゲーションを能動的に使用していない時でも、AIが前方の道路状況(予期せぬ閉鎖や激しい交通渋滞など)を予測し、積極的に通知(アラート)するものです。

これは、Googleマップの役割を「目的地へのアクティブな案内役」から、「日常の移動におけるパッシブな(受動的な)守護者」へと拡大する戦略的な一手と言えます。特に、毎日同じ道を通り、ナビを使わない通勤・通学ユーザーにとって有益です。

このアラートは、会話型インタ Faculdadeの「きっかけ」としても機能するよう設計されています。アラートを受け取ったユーザーが、続けて「これでどれくらい時間が節約できる?」とGeminiに問いかけるといった、シームレスな対話が想定されています。

柱4:マップ内LensとGeminiの融合

マップの検索バーにあるカメラアイコンをタップし、スマートフォンを周囲の建物に向けることで、その場所に関する情報をリアルタイムで取得し、Geminiに質問できるようになります。

例えば、レストランにカメラを向け、「ここは何の店で、なぜ人気があるの?」あるいは「店内の雰囲気は?」といった、非常に具体的で主観的な質問が可能になります。

これは、Google Lensの「AR(拡張現実)レイヤー」と、Googleマップの「情報レイヤー」(レビュー、営業時間)、そしてGeminiの「会話型理解レイヤー」を融合させる試みです。物理世界をスキャンし、それについてデジタル世界とシームレスに対話する、新しい検索の形を示しています。

AIナビゲーションの信頼性:Geminiは「嘘」をつかないのか?

これら4つの柱は強力ですが、ジェネレーティブAIには根本的な弱点が存在します。それは「ハルシネーション(幻覚)」、すなわち事実に基づかない情報を生成する傾向です。

チャットボットが詩を間違えるのは些細な問題です。しかし、ナビゲーションアプリが「幻覚」を起こし、存在しない道を案内したり、営業時間を間違えたりすることは、物理的な危険や重大な不利益に直結します。

Googleマップのようなミッションクリティカルなアプリケーションにおいて、AIの回答の「事実性」は交渉の余地がありません。

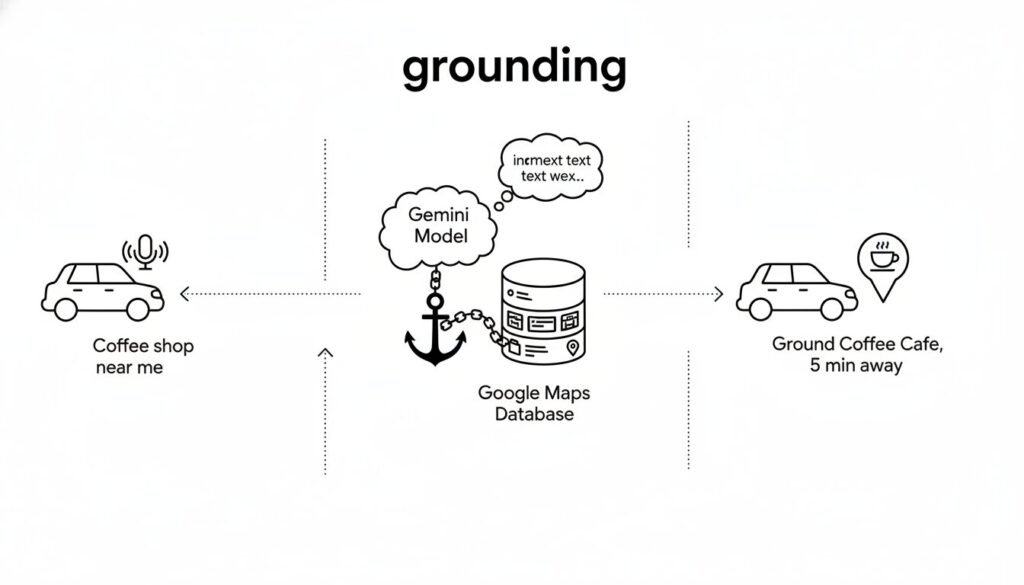

ハルシネーション問題への回答:「グラウンディング」技術

Googleは、この信頼性の問題に対処するため、「グラウンディング(Grounding)」と呼ばれる技術を採用しています。

グラウンディングとは、AIモデル(Gemini)の出力を、検証可能な特定の情報源(この場合はGoogleマップのデータベース)に接続し、応答をそのデータソースに「固定(tether)」または「根付かせる(ground)」技術です。

プロセスは以下の通りです。

- インテント(意図)の認識: ユーザーが「近くのコーヒーショップ」といった地理的な意図を含むクエリを送信します。

- ツールの呼び出し: Geminiモデルは、この「地理的インテント」を認識し、「Grounding with Google Maps」ツールを自動的に呼び出します。

- データ取得: このツールは、Googleマップの2億5000万件以上の場所に関する、リアルタイムで構造化されたデータベース(営業時間、住所、評価など)にクエリを実行し、「事実」を取得します。

- グラウンディングされた生成: Geminiモデルは、この取得した「事実」に基づいて応答を生成します。モデルの内部知識(訓練データ)だけに頼るのではなく、取得したライブデータを根拠とします。

AIが情報を「発明」するのを防ぎ、事実に基づいた応答を生成させる。このアプローチこそが、Googleが持つ20年かけて蓄積したリアルタイムの地理空間データベースという最大の「堀(Moat)」を、AIの弱点を克服するための「錨(アンカー)」として利用する戦略です。

【ロジの視点】

AIの信頼性は、いかに現実の「事実」に根付かせる(グラウンディング)かに懸かっています。Googleの強みは、モデルの賢さそのものよりも、この「事実」のデータベースを自社で排他的に保有している点にあるのです。

重要なリスク評価:浮上する2つの大きな懸念

Geminiの統合は、利便性の向上の一方で、安全性とプライバシーに関する重大な懸念を提起します。この「コ・パイロット」を助手席に乗せるには、コストが伴います。

安全性のパラドックス:「便利さ」が「注意散漫」を引き起こす?

Geminiの統合は、「運転中の注意散漫」という問題に対し、相反する2つの側面を持っています。

- 注意散漫の「削減」: ハンズフリー操作が前提であり、従来は危険を伴った「手動操作」(事故報告のタップや目的地変更)を、すべて自然な音声対話で代替します。これにより、物理的な注意散漫(目を道路から離す、手をハンドルから離す)が減る、というのがGoogleの主張です。

- 注意散漫の「増加」: 一方で専門家は、物理的な操作がなくなっても、「認知的注意散漫」(Cognitive Distraction)が増加する可能性を懸念しています。

Geminiの最大の強みである「自然で連続的な会話能力」こそが、リスクであるという指摘です。ドライバーの認知リソースが「運転」から「AIとの対話」に奪われる可能性があります。

事実、Google自身が、ナビゲーションと無関係なタスク(例:「昨夜の試合の結果を教えて」「小学2年生の算数のカリキュラムについて」)の実行をユースケースとして提示しています。AIが有能で魅力的であるほど、ドライバーは運転以外のタスクに没頭しやすくなるというパラドックスが存在します。

プライバシーのコスト:「コ・パイロット」は常に聞いている

「すべてを記憶する賢い友人」というコンセプトは、プライバシーの観点からは「すべてを監視・記録するシステム」の別名でもあります。

Geminiは、ユーザーの会話、位置情報、フィードバック、利用状況など、広範なデータを収集します。最大のリスクは、人間によるレビュー(Human Review)です。

Googleは公式に、ユーザーに対し「(Geminiに)機密情報を入力しないように」と警告しています。その理由は、ユーザーの会話の一部は、品質改善のために「人間(ヒューマン・レビューア)」によってレビューされるためです。

最も重大な懸念は、たとえユーザーがGeminiのアクティビティを削除したとしても、人間によってレビューされた会話(および関連する位置情報など)は、最大3年間保持されるというポリシーです。

これは、ユーザーが自分の「位置情報」と「会話履歴」の永続的な記録が、人間のアクセス可能な形でGoogleのサーバーに残る可能性を受け入れることを意味します。この「コ・パイロット」を助手席に乗せるためのコストは、決してゼロではないのです。

KEY SIGNAL:

GoogleマップのGemini統合は、アプリの機能追加ではなく、「移動」を中心とした生活OSへの戦略的転換点である。

まとめ:ナビゲーションの未来と、私たちが向き合うべき課題

今回のアップデートの本質を整理します。

この記事のポイントをおさらいしましょう。

- Gemini統合により、マップは「場所を検索する道具」から、「文脈を理解し支援する会話型エージェント(コ・パイロット)」へ根本的にシフトします。

- 「会話型ナビ」「ランドマーク案内」「積極的アラート」「Lens連携」の4つの機能が連携し、アプリ切り替えの不要なシームレスな体験を構築します。

- AIの信頼性の鍵は、AIの回答をGoogleマップの膨大な「事実」データに固定(アンカー)する「グラウンディング」技術にあります。

- 「認知的注意散漫」という新たな安全リスクと、会話データを「人間がレビュー」し「最大3年間保持」するというプライバシーコストが、利便性の代償となります。

Googleの長期的なビジョンは、単なる「会話型マップ」にとどまりません。最終的には、ユーザーが「ルートを尋ねる」のではなく、AIに「目標(Goal)」を与えるだけで、計画から実行までを自律的に処理する「自律型エージェント」の実現です。

2025年11月のアップデートは、その未来に向けた、最も重要かつ決定的な一歩と言えます。この変化の本質を見極め、賢く使いこなしていく必要があります。

以上、最後まで記事を読んでいただきありがとうございました。

当メディア「AI Signal Japan」では、

ノイズの多いAIの世界から、未来を読み解くための本質的な「シグナル」だけを抽出し、分かりやすくお届けしています!

運営者は、ロジ。博士号(Ph.D.)を取得後も、知的好奇心からデータ分析や統計の世界を探求しています。

アカデミックな視点から、表面的なニュースだけでは分からないAIの「本質」を、ロジカルに紐解いていきます。